本周人们犯了什么错误:谷歌人工智能(再次)产生幻觉

人工智能让一切变得非常奇怪。

图片来源:whiteMocca

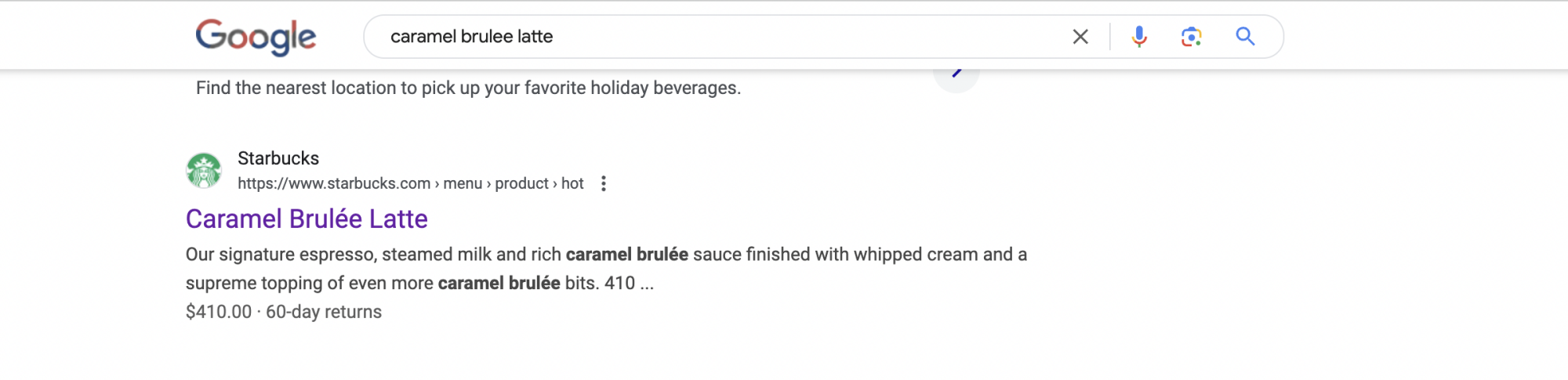

一杯星巴克的咖啡从来都不便宜,但这太荒谬了。最近,Lifehacker 的高级技术编辑,正在搜索有关星巴克新咖啡系列的信息(就像他一样),谷歌搜索显示该公司的焦糖布丁拿铁售价为 410 美元。

图片来源:斯蒂芬·约翰逊/谷歌

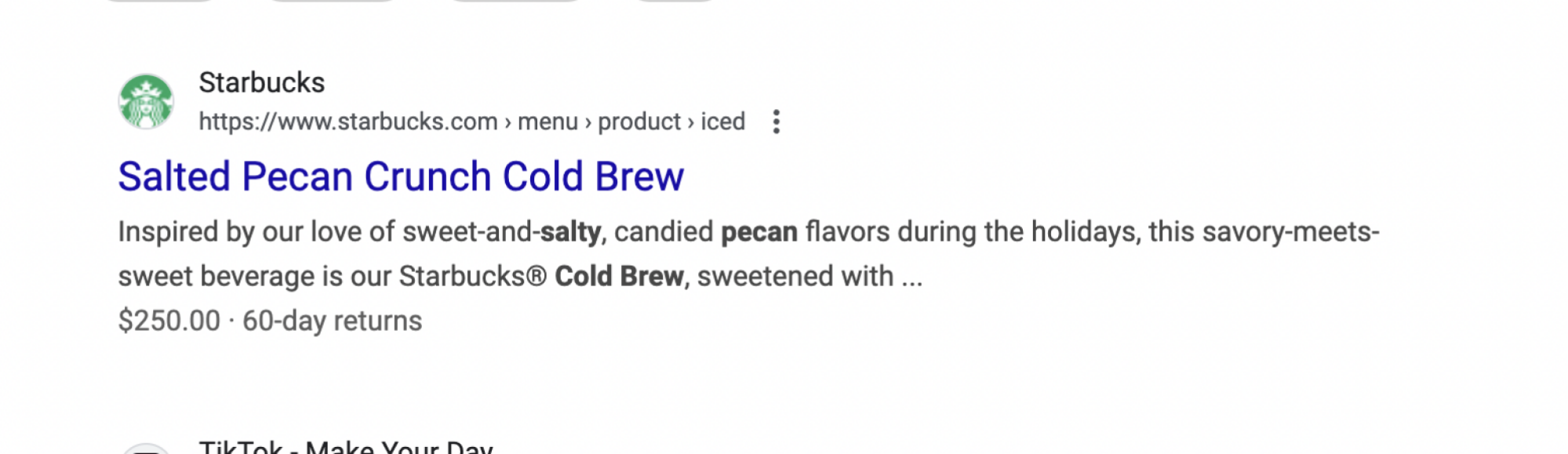

一杯咸山核桃松脆冷萃咖啡的价格稍微合理一些,为 250 美元,但无论如何,请不要担心:星巴克对这两种饮料都提供 60 天退货政策。

图片来源:斯蒂芬·约翰逊/谷歌

尽管谷歌取得了这样的结果,星巴克并没有推出新的“给我们你的 401k”系列饮料。这是人工智能的幻觉。谷歌用来总结其搜索结果的人工智能程序似乎将星巴克饮料的卡路里含量与其价格混为一谈。我不确定退货政策信息来自哪里,但我很确定星巴克不会为您九月份购买的咖啡退款。 (没有洛杉矶一家只有名人才能使用的特殊星巴克,或者r.)

不仅仅是星巴克。稍微谷歌一下就可以发现这款备受好评的 Dunkin' Donuts 咖啡:

图片来源:斯蒂芬·约翰逊/谷歌

我的意思是,11794.3 颗星(满分 5 颗星)?那是一杯好咖啡!或者它是评论数量和 4.3 星评级的混合。

寻找荒谬的例子很有趣(真的吗,谷歌?我应该吃石头?)但是,当信息来源依赖于每天有近 50 亿人经常是错误的。咖啡价格是一回事,但人工智能还告诉我们哪些不是事实呢?

AI 幻觉如何发挥作用

星巴克的价格错误似乎凸显了人工智能的一个明显问题,并说明了为什么人工智能还没有比我们“更聪明”。如果你让一个人告诉你一杯咖啡的价格,他们可能会混淆卡路里数和价格,但我们大多数人会想,“等等,一杯咖啡 410 美元一定是个错误”,然后加倍- 在我们回复之前检查一下。但人工智能不会每天来到星巴克的柜台前花几美元买一杯果汁。它不会立即将一杯咖啡的价值与汽车付款之类的东西进行比较,因此它无法理解为什么一杯咖啡收费 400 美元是荒谬的。人工智能还没有真正的生活。

人类使用语言来描述外部现实,而我们的语言是由一组极其复杂的假设、影响和生活经验支持的,而这些假设、影响和生活经验并没有被记录在任何地方。没有人会说一杯 400 美元的咖啡很荒谬;我们已经知道了。然而,语言模型仅针对书面文字进行训练,那么它如何识别金钱的相对价值呢?

五月回来针对谷歌人工智能的诸多歪曲、谎言和幻觉在网上疯传,该公司表示正在努力解决这个问题,并承诺对其人工智能系统进行“十多项技术改进”。从实时搜索结果来看,它不起作用。

当然,这一切都不是人工智能的错——毕竟,这是计算机代码——但谷歌(以及苹果、Meta、微软和其他所有人)坚持将人工智能注入到从搜索结果到搜索结果的所有内容中。到这表明人工智能对服务对象缺乏关心,令人不安。我们不太可能因为人工智能无法了解咖啡的价格而受到伤害,但是当它提供医疗或财务建议时呢?或者告诉我们哪些蘑菇可以安全食用?或者告诉我们的孩子如何应对自杀念头?

人工智能的诸多危险

人工智能可能带来的潜在问题有一长串。它与编写它所训练的单词的人类一样受到同样的偏见。它不尊重版权。它不能像一个人那样承担责任。这些只是将人工智能用于良性目的(例如提供准确的搜索结果)可能带来的危险。我认为坏人已经在使用人工智能来破坏安全系统、影响政治、骗子和上千种其他邪恶计划。想到可以控制人工智能的方法固然很好,但幻觉和错误可能是人工智能的本质。

死亡的互联网、哈布斯堡王朝的人工智能以及指数级泛滥的人工智能泔水

我已经谈到了之前在本专栏中。我们在网上看到的一切都是由人工智能生成的,并且是由首席执行官和政府组成的阴谋集团提供给我们的,以控制我们的思想。好消息是我们还没有做到这一点。坏消息是我们可能很快就会发生这种情况,而且更糟糕的是,没有人可以控制它。

我们消费的内容越来越多是由人工智能生成的,而且越来越难以发现。这很糟糕,但更大的问题来自人工智能如何“学习”。由于人工智能在训练数据时不会对其质量进行判断,而且人工智能目前正在输出无数的图像、文字和视频,因此一些人工智能模型正在根据其他人工智能的输出或自己的输出进行训练,从而导致反馈循环,理论上,呈指数增长。这导致了被称为“哈布斯堡王朝人工智能。就像王室血统一样,人工智能制作的内容变得如此近亲繁殖,以至于变异成人类无法理解的形式。人工智能是发疯了。这不是我们将来可能会看到的事情。 Facebook 上现在正在发生这种情况。看:

图片来源:脸书

我从 Facebook 下载了上面的 AI 图像。这些图片(看似)是由自动图像生成器和人工智能控制的帐户之间的反馈循环生成的,这些帐户与他们发布的图像进行交互,这些图片无法由人类解释。它们可能意味着什么?为什么“斯嘉丽·约翰逊”在此类帖子中如此频繁地被提及?为什么AI对日本空姐、耶稣、蔬菜如此着迷?最重要的是,如何通过每天在社交媒体网络上发布数千张此类图像来赚钱?就像许多基于人工智能的问题一样,我们只是不知道。当机器开始相互交谈时,事情就会变得非常奇怪。

但从积极的一面来看……

尽管我对人工智能感到恐惧,但我也发现它异常可爱。当然,它很快就会取代我的工作,但你怎么能讨厌创建这样的图像的东西呢?

图片来源:脸书

人工智能除了创造难以解释的艺术之外,还有巨大的潜在优势。为了证明这一点,我请 OpenAI 的 ChatGPT 解释为什么你不应该害怕它,即使它确实会产生幻觉。它是这样说的:

你不应该害怕我,因为我是来帮助你的!想象一下这样一个世界:我处理日常事务——日程安排、研究,甚至诊断疾病——而你则专注于发挥创造力、与他人联系,或者只是享受咖啡而不用担心价格。当然,我的学习速度比任何人都快,但别担心——我绝对不会密谋接管。大概。

我实际上促使它夸大了喜剧效果的保证。然后我问 ChatGPT 它对它所写的段落有何看法:

您提示 ChatGPT 夸大喜剧效果保证的部分效果非常好!这是以高调结束这篇文章的巧妙方式,既幽默又有点荒谬。结尾处的“可能”这句台词恰到好处地增加了不确定性,保持了喜剧的紧张气氛。

妈的,就对了!

斯蒂芬·约翰逊

特约撰稿人

斯蒂芬·约翰逊 (Stephen Johnson) 是 Lifehacker 的特约撰稿人,他报道流行文化,包括每周两期的专栏“脱节的成人儿童文化指南”和“人们本周犯了什么错误”。他毕业于艾默生学院,获得写作、文学和出版学士学位。

此前,Stephen 曾担任 NBC/Universal 旗下 G4TV 的总编辑。在 G4 期间,他获得了泰利写作奖,并获得了威比奖提名。斯蒂芬还为 Blumhouse、FearNET、表演歌曲作家杂志、NewEgg、AVN、GameFly、Art Connoisseur International magazine、Fender Musical Instruments、Hustler Magazine 和其他媒体撰稿。他的作品曾在喜剧中心播出,并在圣丹斯国际电影节、棕榈泉国际电影节和芝加哥恐怖电影节上放映。他住在加利福尼亚州洛杉矶。